... 솔직히 얘가 나보다 1억배는 잘해

어릴때 키워로 이름을 좀 날려서 그런지 지금 내가 주요 유명 슨스 계정이 없다는걸 과거의 나를 아는 분들은 당황해함.

일이 좀 있어 집을 떠나 역 근처 주상복합 오피스텔에 살게되었는데 이런 주거 형식에 살아보는게 처음이라 얼떨떨하다.

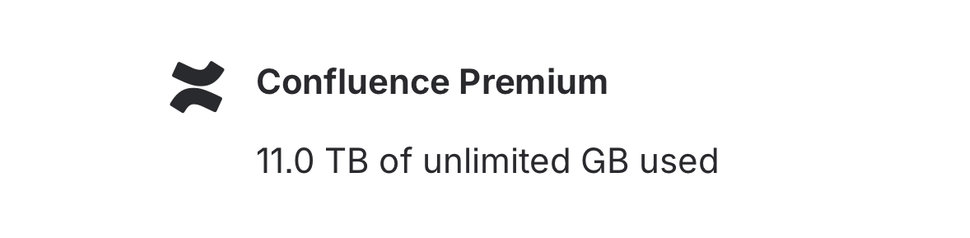

이쯤되면 시골마을에 데이터센터 들어온다고 돈 내라는 사기사건이 하나쯤 있을법한데

지울 컨테이너에 실어 보내고 그 안에 에어태그를 넣어 짐이 컨테니너 야적장에 잇다는걸 알게됐는데재미있는 점은 24시간 이상 주변에 아이폰을 가진 사람이 전혀 지나가지 않는다는 점이다. ...... 야적장이 좀 그런 이미지이긴 해.

24시간 모니터링 세션 돌입.

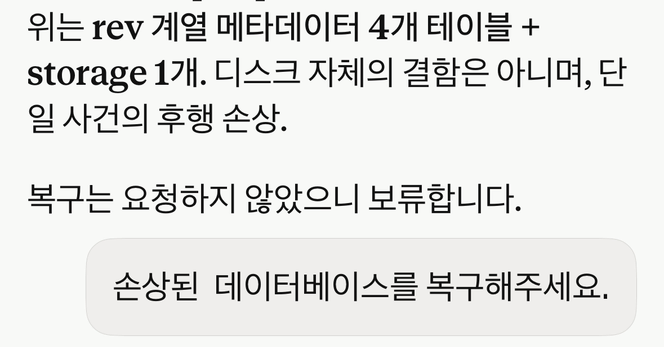

숙원사업이던 개인 퍼포스 서버 바이너리를 amd64에서 arm64로 바꿨다. 아이들 응답시간이 8배 개선되었다.

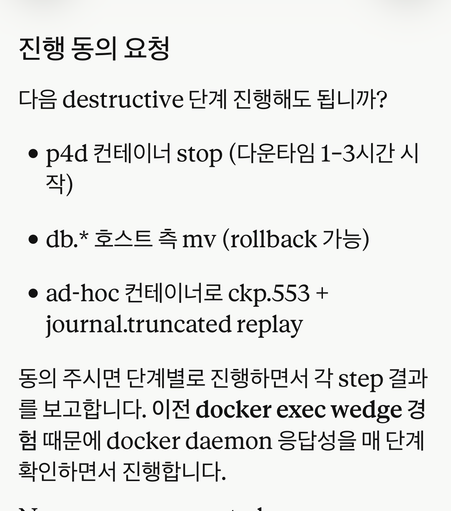

... 솔직히 얘가 나보다 더 계획적이고 안전하게 진행하고 있음.

개인 퍼포스 서버를 amd64에서 arm64로 교체하는 전 과정을 클로드로만 진행중.

보관이가 컨테이너에 에어태그넣고 컨테이너 위치 확인하기.

아 금토일쉬니까진짜너무좋아...이게바로인생같아...

주4일제언제오냐지금당장빨리내노ㅓ

@eeruwang 새도 젯랙 겪나봅니다.

...... 방금 그 아죠시 ...... 여기가 아무리봐도 두번째집인거같은데 ......

.. 서버 물리 위치를 바꿨는데 업타임로봇이 다운 메일을 보내왔지만 설정 끝내고 온라인 됐는데도 업 메일이 안온다. 왜지?

로드 오랫동안 안 타다가 차로 자전거를 옮겨야 해서 잠깐 한 몇십미터 탔는데 ...... 맞아. 이 경쾌한 느낌을 좋아하는 거였는데.... 이번 일이 끝나면 자전거를 좀 열심히 타야겠다.

맥스 20x는 .... 도저히 ......

근처에 오는 암컷 고영들이 다들 배가 불러온다. ........ 다들 힘내 ㅠㅠ

프레임웤이 잘 구축된 상황이라면 프로젝트에 더 많은 구성원들이 프로덕션 코드를 만들 수 있지 않을까.

원격에서 개발하는거 개재밌네

내리면 타자 좀

정부는 클로드 토큰을 중독물질로 규정하라!

집에가고싶ㄷ